整理移动互联架构之HDFSCentos完全分布式集群安装过程详解.docx

整理移动互联架构之HDFSCentos完全分布式集群安装过程详解.docx

- 文档编号:11033093

- 上传时间:2023-02-24

- 格式:DOCX

- 页数:23

- 大小:924.16KB

整理移动互联架构之HDFSCentos完全分布式集群安装过程详解.docx

《整理移动互联架构之HDFSCentos完全分布式集群安装过程详解.docx》由会员分享,可在线阅读,更多相关《整理移动互联架构之HDFSCentos完全分布式集群安装过程详解.docx(23页珍藏版)》请在冰豆网上搜索。

整理移动互联架构之HDFSCentos完全分布式集群安装过程详解

移动互联架构之HDFS(Centos)完全分布式集群安装过程详解

2013.9.28撰稿人:

晓君

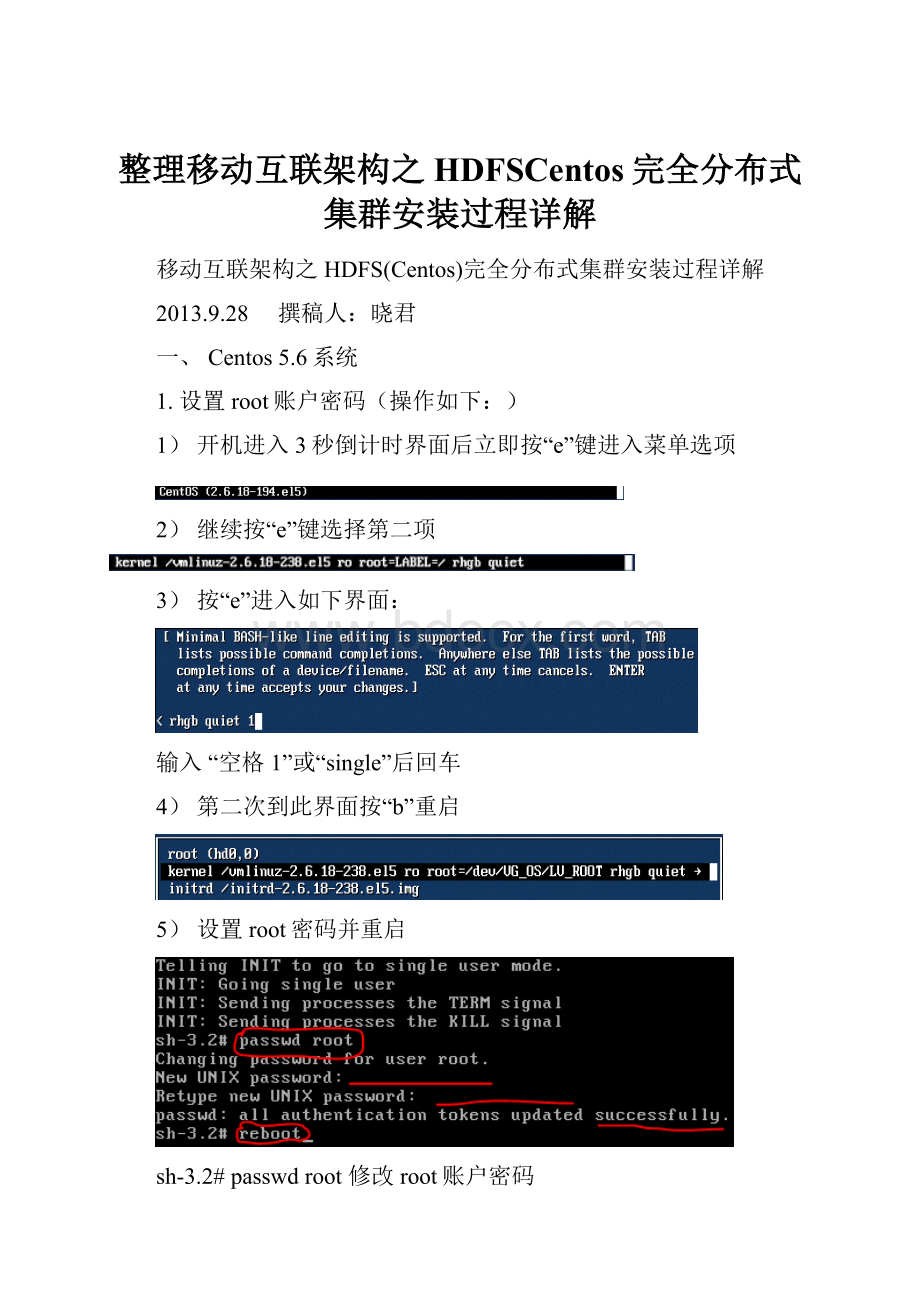

一、Centos5.6系统

1.设置root账户密码(操作如下:

)

1)开机进入3秒倒计时界面后立即按“e”键进入菜单选项

2)继续按“e”键选择第二项

3)按“e”进入如下界面:

输入“空格1”或“single”后回车

4)第二次到此界面按“b”重启

5)设置root密码并重启

sh-3.2#passwdroot修改root账户密码

sh-3.2#reboot重启

至此,Centos5系统root账户密码已修改完成

二、HDFS安装准备:

1.Centos5.6系统设置

1)设置centos5.6系统ip地址

打开filesystem\etc\sysconfig\network-scripts\ifcfg文件

DEVICE=eth0

ONBOOT=yes

BOOTPROTO=static指定静态IP

IPADDR=x.x.x.x设置静态IP地址

NETMASK=255.255.255.0置子网掩码

TYPE=Ethernet指定网口类型

IPV6INIT=no不起用IPv6协议

HWADDR=00:

0C:

29:

CF:

62:

72网卡地址(默认)一般不需要修改

2)设置网关和主机名

打开filesystem\etc\sysconfig\network

NETWORKING=yes

NETWORKING_IPv6=no不开启IPv6协议

GATEWAY=x.x.x.x设置网关

HOSTNAME=@#$%^&*设置要修改的主机名

3)设置DNS

打开filesystem\etc\resolv.conf

Searchlocalhost如果是本地,使用默认的“localhost”如果是域

可将默认的“localhost”更改为域名

nameserver=x.x.x.x主DNS

nameserver=x.x.x.x备DNS

4)打开Applications-Accessories-Teminal

[root@xxx~]#servicenetworkrestart重启网卡

如你设置的IP有冲突会有提示,如果你的DNS或子网掩码、网关不对,这

里是拼不通其他电脑的

2.安装JDK

1)下载jdk-6u21-linux-i586-rpm.bin

下载地址:

在filesystem\opt下创建一个jdk文件夹用来存放拷过来的java包,并将jdk-6u21-linux-i586-rpm.bin放入其中

2)打开Applications-Accessories-Teminal

[root@xxxx~]#cd/opt/jdk进入存放java的根目录

[root@xxxxjdk]#ls查看当前目录下的文件

jdk-6u21-linux-i586-rpm.bin

[root@xxxxjdk]#shjdk-6u21-linux-i586-rpm.bin安装java

[root@xxxxjdk]#安装完成后返回当前目录

Java环境到此安装完毕,默认路径为:

JAVA_HOME=/usr/java/jdk1.6.0_21

3)解压hadoop

下载hadoop1.0.4

下载地址:

在filesystem\opt下创建一个hadoop文件夹用来存放拷过来的

hadoop包,并将hadoop1.0.4.tar.gz放入其中

进入Applications-Accessories-Teminal

[root@xxxxx~]#cd/opt/hadoop进入创建好的文件夹

[root@xxxxxhadoop]#ls查看子文件

hadoop1.0.4.tar.gz

[root@xxxxxhadoop]#tar-zxvfhadoop1.0.4.tar.gz解压

hadoop1.0.4

[root@xxxxxhadoop]#

*.bz的包用:

tar–jxvfhadoop1.0.4.tar.bz解压

三、部署

在这里我用4台虚拟机搭建

1)用VmwareWorkstation创建4个虚拟机,每个虚拟机都装上Centos(版本:

CentOS-5.6-x86_64),示意图如下:

2.)在所有结点上修改/etc/hosts,使彼此之间都能够用机器名解析IP

10.9.23.1 master设置master主节点对应的IP是10.9.23.1

10.9.23.2 data1设置data1数据节点IP是10.9.23.2

10.9.23.3 data2设置data1数据节点IP是10.9.23.3

10.9.23.4 data3设置data1数据节点IP是10.9.23.4

3)在所有结点上安装JDK

方法同2.2

4)更改/etc/profile,添加以下几行:

JAVA_HOME=/usr/java/jdk1.6.0_21

JRE_HOME=/usr/java/jdk1.6.0_21/jre/

CLASSPATH=.:

$JAVA_HOME/lib:

$JAVA_HOME/lib/tools.jar

PATH=$JAVA_HOME/bin

5)ssh配置

[root@master~]$ssh-keygen-trsa生成密钥

Generatingpublic/privatersakeypair.生成公有、私有密钥

Enterfileinwhichtosavethekey(/home/hadoop/.ssh/id_rsa):

/home/hadoop/hadoop/.ssh'密钥存放路径

Enterpassphrase(emptyfornopassphrase):

输入密钥密码(我这里设置

密码为空)

Entersamepassphraseagain:

确认密码

Youridentificationhasbeensavedin/home/hadoop/hadoop/.ssh/id_rsa.

Yourpublickeyhasbeensavedin/home/hadoop/hadoop/.ssh/id_rsa.pub.

Thekeyfingerprintis:

1d:

03:

8c:

2f:

99:

95:

98:

c1:

3d:

8b:

21:

61:

3e:

a9:

cb:

bfhadoop@node01

Thekey'srandomartimageis:

+--[RSA2048]----+

| oo.B.. |

| o..**. |

| +.Boo |

| ..=o.o |

|. .S. |

|.. |

|o |

| . |

| E. |

+-----------------+

[root@master~]$cd~/.ssh进入存放密钥的目录

[root@master.ssh]$scpid_rsa.pubroot@data1:

~/.ssh/authorized_keys

将公有密钥导入authorized_keys里并拷贝给下面三个节点(这里拿出一个

节点示范)

把所有结点的authorized_keys的内容都互相拷贝,这样就可以免密码ssh连入。

6.安装Hadoop

将解压的hadoop包拷贝到/home/hadoop下,下面的3个节点都是一样操作

7.配置namenode(master)

1)修改hadoop-env.sh

进入/home/hadoop/hadoop/conf

找到hadoop-env.sh用textedit打开

加入java安装路径:

exportJAVA_HOME=/usr/java/jdk1.6.0_21

2)修改core-site.xml

进入/home/hadoop/hadoop/conf用textedit打开core-site.xml

//10.9.23.1:

9000设置主节点浏览地址和端口

3)修改hdfs-site.xml

进入/home/hadoop/hadoop/conf用textedit打开hdfs-site.xml

在/home/hadoop/hadoop下创建data和tmp文件夹

4)修改mapred-site.xml

进入/home/hadoop/hadoop/conf用textedit打开mapred-site.xml

在/home/hadoop/hadoop下创建一个local文件夹

9001设置浏览jobtracker的地址和端口

tasktracker模块中maptask服务

tasktracker模块中reducetask服务

4)修改masters和slaves文件,记录集群中各个结点

进入/home/hadoop/hadoop/conf用textedit打开master

Master主节点主机名

查看主机名可进入Applications-Accessories-Teminal

[root@xxxxx~]#uname–n

master

进入/home/hadoop/hadoop/conf用textedit打开slaves

data1

data2

data3

将master和slaves设置好的文件复制到data1、data2、data3主机的/home/hadoop/hadoop/conf下覆盖原本系统已有的master和slaves文件

5)在各个结点上配置profile环境变量

进入/etc/profile用textedit打开

加入java环境变量和hadoop环境变量

exportHADOOP_INSTALL=/home/hadoop/hadoop

exportPATH=$PATH:

$HADOOP_INSTALL/bin

6)设置bachrc文件

进入/etc/bashrc用textedit打开

加入java环境变量

exportHADOOP_INSTALL=/home/hadoop/hadoop

exportPATH=$PATH:

$HADOOP_INSTALL/bin

四、格式化HDFS

[root@nmasterhadoop]$bin/hadoopnamenode-format

13/01/3000:

59:

04INFOnamenode.NameNode:

STARTUP_MSG:

/************************************************************

STARTUP_MSG:

StartingNameNode

STARTUP_MSG:

host=master/10.9.23.1

STARTUP_MSG:

args=[-format]

STARTUP_MSG:

version=1.0.4

STARTUP_MSG:

build=https:

//svn.apache.org/repos/asf/hadoop/common/branches/branch-1.0.4-r911707;compiledby'chrisdo'onFriFeb1908:

07:

34UTC2013

************************************************************/

13/01/3000:

59:

04INFOnamenode.FSNamesystem:

fsOwner=hadoop,root

13/01/3000:

59:

04INFOnamenode.FSNamesystem:

supergroup=supergroup

13/01/3000:

59:

04INFOnamenode.FSNamesystem:

isPermissionEnabled=true

13/01/3000:

59:

04INFOcommon.Storage:

Imagefileofsize96savedin0seconds.

13/01/3000:

59:

04INFOcommon.Storage:

Storagedirectory/tmp/hadoophadoop/dfs/namehasbeensuccessfullyformatted.

13/01/3000:

59:

04INFOnamenode.NameNode:

SHUTDOWN_MSG:

/************************************************************

SHUTDOWN_MSG:

ShuttingdownNameNodeatmaster/10.9.23.1

************************************************************/

1)启动守护进程

注意,在启动守护进程之前,一定要先关闭防火墙(所有的结点都要),否则datanode启动失败。

[root@data1~]#/etc/init.d/iptablesstop

iptables:

Flushingfirewallrules:

[OK]

iptables:

SettingchainstopolicyACCEPT:

filter [ OK ]

iptables:

Unloadingmodules:

[ OK ]

最好设置开机就不启动防火墙:

[root@master~]#vi/etc/sysconfig/selinux

SELINUX=disable

[root@masterhadoop]$bin/start-all.sh

startingnamenode,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-namenode-master.out

data3:

startingdatanode,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-datanode-data3.out

data2:

startingdatanode,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-datanode-data2.out

data1:

startingdatanode,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-datanode-data1.out

root@master'spassword:

master:

startingsecondarynamenode,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-secondarynamenode-master.out

startingjobtracker,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-jobtracker-master.out

data3:

startingtasktracker,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-tasktracker-data3.out

data2:

startingtasktracker,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-tasktracker-data2.out

data1:

startingtasktracker,loggingto/home/hadoop/hadoop/bin/../logs/hadoop-hadoop-tasktracker-data1.out

2)检测守护进程启动情况:

Master结点:

[root@masterjdk1.6.0_21]$bin/jps

3986Jps

3639NameNode

3785SecondaryNameNode

3858JobTracker

Slave结点(以data1为例):

[root@data1~]#/usr/java/jdk1.6.0_21

[root@data1jdk1.6.0_21]#bin/jps

3254TaskTracker

3175DataNode

3382Jps

3)查看节点状态:

http:

//master:

50070/

http:

//master:

50030

4)端点查看

http:

//data1:

50060/tasktracker.jsp

5)上传文件查看

http:

//data1:

50075/browseDirectory.jsp?

dir=%2Fhome%2Fhadoop%2Fhadoop%2Ftmp&namenodeInfoPort=50070

6)文件下载

2)应用环境质量标准时,应结合环境功能区和环境保护目标进行分级。

7)文件上传

假设上传jdk,首先进入jdk存放目录

[root@data1~]#cd/opt/JDKjdk存放目录

[root@data1JDK]#ls查看目录下的文件

2)间接使用价值。

间接使用价值(IUV)包括从环境所提供的用来支持目前的生产和消费活动的各种功能中间接获得的效益。

jdk-6u21-linux-i586-rpm.bin

[root@data1JDK]#cd~返回根目录

第1页[root@data1~]#cd/home/hadoop/hadoop进入hadoop目录(因为执行程序在此目

录下)

内涵资产定价法基于这样一种理论,即人们赋予环境的价值可以从他们购买的具有环境属性的商品的价格中推断出来。

[root@data1hadoop]#bin/hadoopfs–put/opt/JDK/jdk-6u21-linux-i586-

2)间接使用价值。

间接使用价值(IUV)包括从环境所提供的用来支持目前的生产和消费活动的各种功能中间接获得的效益。

rpm.bin/tmp/将jdk软件上传到HDFSdata1节点的

tmp文件目录里

[root@data1hadoop]#未报错表示上传成功

(1)生产力变动法

四、环境影响的经济损益分析SSH操作界面

1.环境影响评价依据的环境标准体系到data1下的tmp目录下查看刚上传的jdk软件

五、总结:

Linux下hadoopHDFS大数据存储的工作原理就是:

1.

2.

(2)规划编制机关在报送审批专项规划草案时,将环境影响报告书一并附送。

用一个namenode总节点查看整个集群状态和信息

3.

4.C.环境影响报告书分数据节点承担对外接口的功能,提供上传下载服务

5.分节点相互实现了复制,任何一个节点挂了资料不会丢失

6.实现分布式计算,把一些大文件或数据平均分配给N各节点传输,相当于一个文件N个CPU和硬盘同时处理,所以在速度上远超于一般的存储,而且

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- 整理 移动 架构 HDFSCentos 完全 分布式 集群 安装 过程 详解

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰豆网所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《Java程序设计》考试大纲及样题试行.docx

《Java程序设计》考试大纲及样题试行.docx